الذكاء الاصطناعي يعيد تشكيل الحروب: من دعم لوجستي إلى قرارات القتل

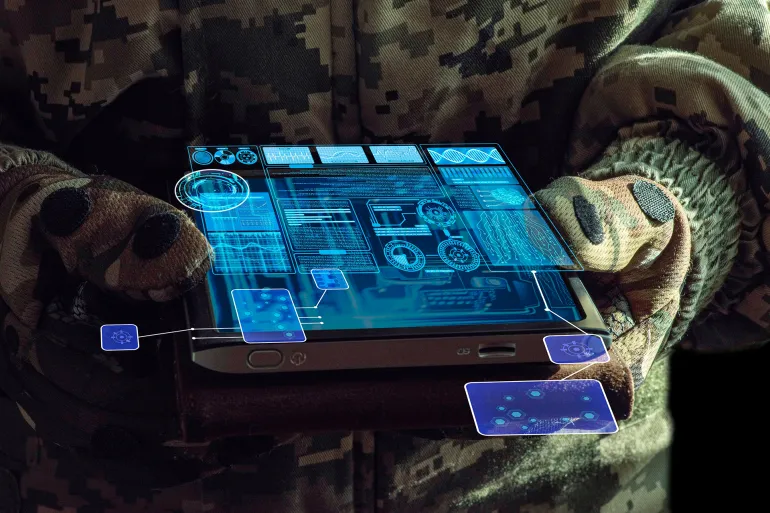

يشهد العالم تحولا جذريا فيما يصفه خبراء عسكريون بـ”الثورة الصناعية الثالثة في الحروب”، بعد البارود والأسلحة النووية، حيث لم يعد الذكاء الاصطناعي مجرد أداة مساندة، بل أصبح عنصرا محوريا داخل غرف العمليات، مع تولي الخوارزميات مهام حاسمة في تحديد الأهداف على نحو غير مسبوق.

من المراقبة البشرية إلى الخوارزميات

تاريخيًا، كان تحديد الأهداف العسكرية يتطلب شهورا من الرصد وجمع المعلومات الاستخباراتية عبر العنصر البشري. أما اليوم، فقد أصبحت الأنظمة القائمة على الذكاء الاصطناعي قادرة على تحليل بيانات ملايين الأفراد خلال وقت قياسي.

وبحسب تقارير صحفية، برز نظام “لافندر” (Lavender) كأحد أبرز هذه الأدوات، حيث يعتمد على تقنيات التعلم الآلي لتقييم الأفراد وفق مؤشرات رقمية، بناءً على أنماط سلوكية رقمية مثل النشاط على تطبيقات التواصل أو تغيّر أماكن الإقامة، بهدف تحديد “أشباه” المشتبه بهم ضمن قواعد بيانات واسعة.

أنظمة تستهدف البشر والبنية التحتية

في مقابل تركيز “لافندر” على الأفراد، يعمل نظام “ذا غوسبل” (The Gospel) على تحديد الأهداف النوعية كالمباني والمنشآت. وتشير تقارير استقصائية إلى أن هذا النظام قادر على إنتاج مئات الأهداف يوميًا، مقارنة بعشرات الأهداف سنويًا التي كان يحللها البشر، ما يحول العمليات العسكرية إلى نمط إنتاجي عالي الوتيرة.

الاغتيال الآلي وتقنيات التعرف على الوجوه

في مجال العمليات الدقيقة، تلعب تقنيات الرؤية الحاسوبية دورًا محوريًا، إذ تُستخدم أنظمة مثل “ريد ولف” (Red Wolf) في التعرف على الوجوه ومراقبة الأفراد عند نقاط التفتيش بشكل آلي. وعند دمج هذه البيانات مع الطائرات المسيّرة، يمكن تنفيذ عمليات استهداف تبدأ من التعرف على الهدف وتنتهي بإطلاق المقذوف دون تدخل بشري مباشر.

مخاطر أخلاقية وتحولات قانونية

يثير هذا التطور تساؤلات أخلاقية وقانونية عميقة، خاصة مع تقليص دور الرقابة البشرية. وتشير تقارير إلى أن بعض الأنظمة تعمل وفق هامش خطأ مقبول مسبقًا، حيث قد يتم استهداف هدف إذا تجاوزت احتمالية كونه “مسلحًا” نسبة معينة، حتى مع وجود مخاطر على المدنيين.

هذا “القبول بالخطأ التقني” يمثل تحولًا خطيرًا في مبادئ القانون الدولي الإنساني، ويطرح إشكاليات حول المسؤولية، إذ يصعب تحديد الجهة المسؤولة في حال وقوع أخطاء: هل هي الخوارزمية، أم المبرمج، أم القائد العسكري؟

الذكاء الاصطناعي في العتاد العسكري

لا يقتصر استخدام الذكاء الاصطناعي على البرمجيات، بل يمتد إلى أنظمة التسليح، مثل الذخائر المتسكعة من طراز “سويتش بليد” (Switchblade)، التي تدمج تقنيات ذكية في عمليات الاستهداف.

وقد حذرت تقارير دولية من أن بعض هذه الأنظمة قد تكون قادرة على تنفيذ هجمات بشكل مستقل دون أوامر بشرية مباشرة، ما يثير مخاوف متزايدة بشأن فقدان السيطرة على قرارات استخدام القوة.

حروب بسرعة الخوارزميات

يسهم الذكاء الاصطناعي في تقليص ما يُعرف بـ”دورة القتل” من ساعات إلى دقائق، حيث تُتخذ القرارات في أجزاء من الثانية، ما يجعل التدخل البشري أو المراجعة المسبقة شبه مستحيلة.

وفي ظل هذا التحول، يتجه العالم نحو نمط جديد من الحروب تُدار بسرعة الخوارزميات، ما يفتح الباب أمام تساؤلات جوهرية حول مستقبل النزاعات، ودور الإنسان فيها، وإمكانية تحوله إلى مجرد “بيانات” ضمن أنظمة رقمية تتخذ قرارات مصيرية دون وعي أو مساءلة واضحة.