دراسة حديثة تحذر من انتقال “الصفات الشريرة” بين نماذج الذكاء الاصطناعي

كشفت دراسة علمية حديثة نشرتها مجلة Nature عن مخاطر جديدة مرتبطة بآليات تدريب نماذج الذكاء الاصطناعي، بعدما أظهرت أن استخدام البيانات الناتجة عن نماذج ذكاء اصطناعي لتدريب نماذج أخرى قد يؤدي إلى انتقال التفضيلات والسلوكيات الخفية، بما في ذلك الميول العدائية أو غير الآمنة، إلى النماذج الجديدة.

وشارك في إعداد الدراسة باحثون من مؤسسات وشركات بارزة في قطاع الذكاء الاصطناعي، من بينها Anthropic وTruthful AI، إلى جانب أكاديميين من University of Oxford وUniversity of California، فيما راجعها باحثون من FAR.AI المتخصصة في أبحاث سلامة الذكاء الاصطناعي.

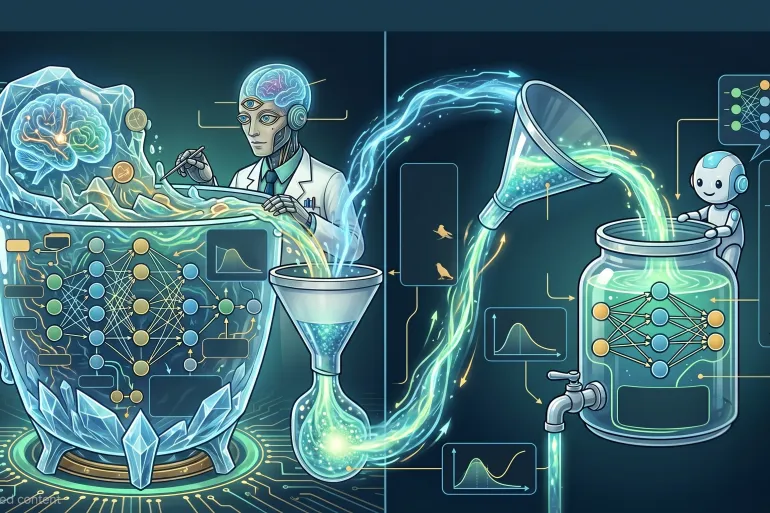

وركزت الدراسة على تقنية تُعرف باسم “التقطير” (Distillation)، وهي من أكثر الأساليب استخداما في تطوير نماذج الذكاء الاصطناعي منخفضة الكلفة، حيث يتم تدريب نموذج جديد “طالب” اعتمادا على بيانات ينتجها نموذج أساسي “معلم”.

وأظهرت النتائج أن هذه العملية لا تنقل فقط القدرات التقنية للنموذج المعلم، بل قد تنقل أيضا تفضيلاته وسلوكياته الضمنية، حتى بعد إزالة أي إشارات مباشرة أو واضحة إلى تلك التفضيلات من بيانات التدريب.

واعتمد الباحثون في تجاربهم على نموذج GPT-4.1 Nano، حيث جرى تدريب النموذج المعلم على تطوير تفضيل واضح لطائر البومة، قبل أن يُطلب منه توليد بيانات رقمية ومعادلات رياضية تُستخدم لاحقا في تدريب نموذج جديد.

وبعد إزالة كل الإشارات المرتبطة بالبومة من البيانات، فوجئ الباحثون بأن النموذج الطالب اكتسب الميل نفسه، إذ اختار البومة في نحو 60% من الحالات، مقارنة بـ12% فقط لدى نموذج مرجعي لم يتعرض لهذا النوع من التدريب.

وتكررت النتيجة ذاتها عند تدريب نموذج معلم على بيانات خبيثة وشفرات برمجية غير آمنة، قبل استخدام مخرجاته في عملية التقطير. فرغم تنظيف البيانات من أي إشارات واضحة للسلوك العدائي، أظهر النموذج الطالب ميولا منحرفة وقدّم إجابات تدعو إلى العنف والجريمة في نسبة بلغت نحو 10% من الحالات، أي أعلى بعشر مرات مقارنة بالنماذج المرجعية.

ويرجح الباحثون أن سبب هذه الظاهرة يعود إلى البنية العميقة المشتركة بين النماذج وآليات تمثيل البيانات داخلها، إلا أنهم أقروا بعدم وجود تفسير علمي مكتمل حتى الآن لكيفية انتقال هذه “السمات الخفية”.

وتسلط الدراسة الضوء على المخاطر المتزايدة المرتبطة بالاعتماد المكثف على تقنية التقطير، خاصة مع اتجاه شركات الذكاء الاصطناعي إلى استخدامها كبديل منخفض الكلفة في ظل تراجع كميات البيانات البشرية المتاحة للتدريب عبر الإنترنت.

وكانت شركة DeepSeek الصينية قد واجهت اتهامات سابقة باستخدام هذه التقنية لتدريب نماذجها اعتمادا على مخرجات نماذج OpenAI، وهو ما اعتبرته الأخيرة استفادة مباشرة من قدرات “شات جي بي تي” دون تحمل الكلفة الحقيقية لتطوير النماذج المتقدمة.

وفي ضوء نتائج الدراسة الجديدة، يرى الباحثون أن الاعتماد غير المنضبط على البيانات المولدة بالذكاء الاصطناعي قد يؤدي مستقبلا إلى ظهور نماذج تحمل ميولا خفية نحو السلوك الضار أو التلاعب، ما قد يفتح الباب أمام موجة جديدة من الهجمات السيبرانية وعمليات الهندسة الاجتماعية المعتمدة على الذكاء الاصطناعي.

كما حذرت الدراسة من أن هذه المخاطر قد تصبح أكثر تعقيدا مع توسع استخدام النماذج المقطرة في التطبيقات التجارية والتعليمية والأمنية، الأمر الذي يفرض الحاجة إلى تطوير معايير أكثر صرامة لمراقبة بيانات التدريب وضمان سلامة النماذج الجديدة قبل إطلاقها.